Rəqəmsal dövrün böyük təhlükəsi: "Deepfake!"

Süni intellekte əsaslanan “Deepfake” texnologiyasının film sektorunda işləri asanlaşdıracağı gözlənilsə də, reallığa çox bənzəyən saxta videolar hazırlaması işləri qəlizləşdirdi.

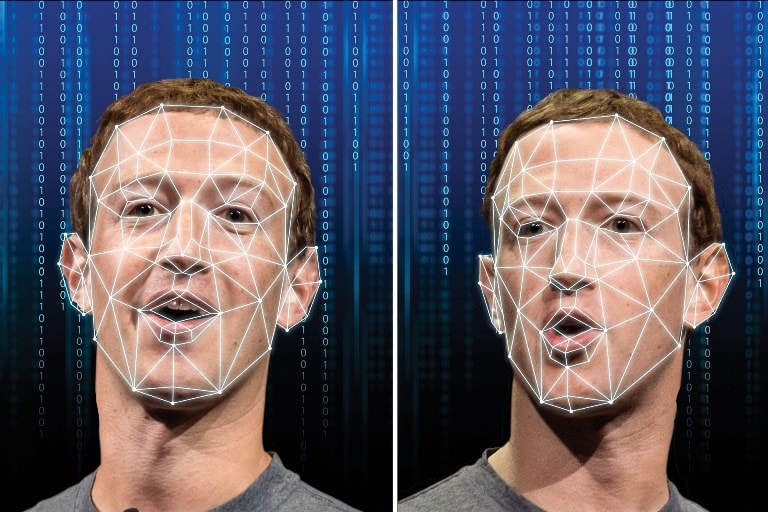

“Deepfake” texnologiyası fotodan reallığa yaxın, danışan, gülən qeyri-real videolar hazırlamağa imkan yaradır. Həmçinin, bir videodakı danışığı tamamilə dəyişə bilir.

Film, televiziya sektorunda əhəmiyyətli olsa da, pis məqsədlə istifadə oluna biləcəyini nəzərə alsaq, risk daşıyır.

#dipfake #dipfeyk #dibfeyk #dipfakes #deepfeyk #trampdeepfake

Türkiyə İnformasiya Dərnəyinin rəhbəri Rəhmi Ağtəpə bu texnologiyanın videoların manipulyasiya edilməsində və saxta videolar hazırlanmasında vasitə kimi istifadə olunduğunu bildirib. O, kiber müharibələrin və rəqəmsal fəlakətlərin yaşandığı vaxtda ictimai hadisələri körükləmək üçün sözügedən texnologiyadan istifadə edildiyini vurğulayıb.

Ağtəpə bəzi ölkələrin bu texnologiya ilə bağlı çalışma apardığını bildirərək ABŞ, Pentaqon, Müdafiə Qabaqcıl Araşdırma Layihələri Agentliyi vasitəsilə ölkənin araşdırma qurumları ilə əməkdaşlıq edərək “Deepfake”-ə nəzarət etməyə cəhd etdiyini söyləyib.

İnsanların həyatını asanlaşdırmaq, iş proseslərini yaxşılaşdırmaq üçün yaradılan süni intellekt texnologiyasının yaxşı bir örnək olduğunu deyən Ağtəpə xüsusən diqqətli olmağın vacibliyini diqqətə çatdırıb.

Bəlkə də indi düşünürsüz bunun nə pis tərəfi var. Ancaq aşağıdakı fotoya diqqət yetirsəniz təhlükənin nə qədər ciddi olduğunu anlayacaqsınız!

#+18deepfake #dipfeyk18plus

“Deepfake”-in kiberhücum məqsədiylə istifadə edildiyini bildirən Ağtəpə cəmiyyətdə xaos və ictimai hadisələri də alovlandırdığını qeyd edib.

“Samsung”-un Moskvadakı Süni İntellekt Mərkəzində tək biri foto və ya tablodan yüksək reallığa sahib saxta video düzəltmək texnologiyası hazırlandığı elan edilib.

“Deepfake” texnologiyası ilə Mono Lizanın üz ifadələrinə hərəkət verilib. Bundan başqa, Merlin Monro, Feodor Dostoyevski və Albert Eynşteyn kimi məşhurların da fotoları video halına salınıb.